C’est la deuxième partie de la « Feuille de route pour une IA responsable pour les OSC ». Pour en savoir plus, lisez l'article « De la tension au principe : Comment les OSC peuvent-elles jouer un rôle de premier plan dans le domaine de l'IA responsable ? », l'introduction du guide (avec le calendrier de publication de chacune des parties), et la Partie 1 : REGARDER - Préparer le terrain.

Dans la partie 2 : CRÉER, préparez-vous à identifier les principes les plus significatifs pour votre organisation et apprenez à les définir.

2.1 La méthode de recherche des valeurs fondamentales

Ce cadre est adapté de l'ouvrage d'Olivia Gambelin intitulé L'IA responsable , qui propose une méthode pratique permettant aux organisations d'identifier les valeurs qui s'alignent sur les dimensions réglementaires, écosystémiques et organisationnelles.

→ Utiliser la feuille de travail Fiche d'identification et de définition des principes de l'IA pour travailler sur cette section. Cette feuille de travail contient le tableau d'évaluation de l'alignement et toutes les références à l'appui.

Préparer le terrain :

Si vous avez recueilli des tensions par le biais des entretiens pré-session, commencez par présenter au groupe la synthèse des enseignements. Partagez les thèmes récurrents que vous avez entendus, les espoirs, les craintes et les éléments non négociables qui ont émergé. Laissez du temps au groupe pour réagir et compléter ce qui a été recueilli.

Si vous faites émerger les tensions en direct, commencez par les 5 questions. Prévoyez 5 minutes de réflexion individuelle, puis 15 à 20 minutes de partage en groupe. Consignez tous les éléments sur un paperboard ou dans un document partagé.

Une fois les tensions mises en évidence, votre équipe dispose désormais :

Des enseignements issus des entretiens ou de la réflexion (ce que vous tenez à protéger)

D’un inventaire de l’IA montrant ce qui est utilisé et les préoccupations existantes

De la sagesse existante : les valeurs de votre organisation, les réglementations pertinentes et les références du secteur

Vous pouvez maintenant rassembler ces éléments pour identifier les principes qui comptent le plus.

Construire votre liste de principes :

Commencez par rassembler tous les principes que vous avez identifiés lors de la phase REGARDER :

Les principes communs d’IA responsable issus de l’analyse des référentiels et des benchmarks (les 6 à 12 les plus fréquemment cités)

Les valeurs et principes déjà existants dans votre organisation

Les principes apparus lors des discussions sur les tensions (par exemple, si la notion d’« authenticité » revient souvent, cela peut indiquer un principe comme « l’humain au cœur »)

Les principes suggérés par votre cadre réglementaire

Vous obtiendrez probablement 12 à 20 principes candidats. C’est tout à fait normal. L’étape suivante consiste à vous aider à les prioriser.

Évaluation de l'alignement :

Pour chaque principe, évaluez sa pertinence selon trois dimensions :

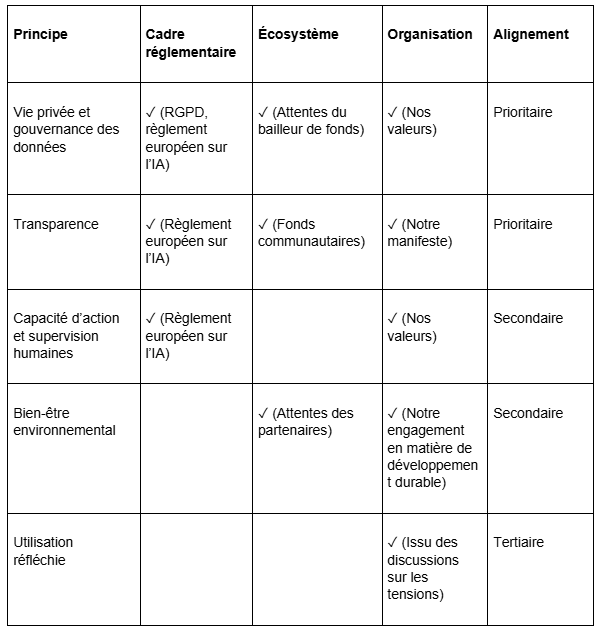

(Exemple de brouillon)

→ La feuille de travail Identifier | Définir les principes de l'IA inclut ce tableau prêt à remplir ainsi que la référence au règlement européen sur l’IA pour guider l’alignement avec les principes afin de vous aider à remplir la colonne Cadre réglementaire.

Ce que la phase REGARDER apporte :

Colonne Cadre réglementaire : Votre recherche sur le paysage réglementaire vous indique quels principes sont légalement requis ou encouragés.

Colonne Écosystème : Votre compréhension des attentes des bailleurs de fonds, des partenaires et de la communauté vous indique quels principes sont importants pour vos parties prenantes.

Colonne Organisation : Vos valeurs existantes ET vos tensions vous indiquent quels principes sont au cœur de votre identité.

La discussion sur les tensions est particulièrement précieuse à cet égard. Si votre équipe s'est montrée très préoccupée par l'authenticité, cela vous oriente vers des principes tels que « l'humain au cœur ». Si la confidentialité des données est mentionnée à plusieurs reprises dans l'inventaire, cela indique que le principe « confidentialité et gouvernance des données » est prioritaire.

Notation de l'alignement :

Prioritaire (3 cases cochées): Le principe apparaît dans les trois sources. Il s'agit d'un élément fondamental, non négociable.

Secondaire (2 cases cochées): Le principe apparaît dans deux sources. Il est important et sert à guider la prise de décision lorsque les principes prioritaires sont en conflit.

Tertiaire (1 case cochée): Le principe apparaît dans une seule source. Il peut être encore important pour votre organisation en particulier, même s'il n'est pas mis en évidence ailleurs.

Visez 3 à 7 principes prioritaires. Un nombre supérieur devient difficile à gérer ; un nombre inférieur peut entraîner l'omission de certaines dimensions importantes. Ces principes fondamentaux constituent le point de départ d'une définition détaillée.

2.2 De l'identification à la définition

L'identification des principes ne représente que la moitié du travail. Un principe tel que l’« équité » ou la « transparence » n'a pas la même signification pour toutes les organisations. Votre tâche consiste à définir la signification de chaque principe dans votre contexte.

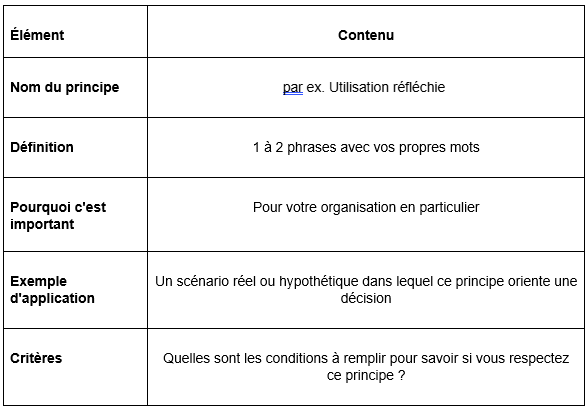

→ La feuille de travail Identifier | Définir les principes de l'IA inclut un modèle de définition pour chaque principe. Utilisez-le pour recueillir les réponses de votre équipe aux questions ci-dessous.

Définir les questions :

Pour chaque principe que vous avez identifié comme prioritaire(et éventuellement secondaire), répondez en équipe aux questions suivantes :

Que signifie ce principe pour notre organisation dans le contexte de l'IA ? Quel est le lien avec notre mission, nos valeurs et le travail spécifique que nous effectuons ? Qu'est-ce qui rend notre interprétation unique ?

Pourquoi ce principe est-il important pour nous ? Quels sont les avantages potentiels si nous le maintenons ? Quels sont les risques ou les conséquences négatives si nous ne le maintenons pas ?

Pouvez-vous penser à un exemple concret où ce principe serait particulièrement important ou mis à l’épreuve ? Appuyez-vous sur votre travail concret : une situation réelle ou un scénario plausible.

Quels critères nous permettraient de vérifier que nous respectons bien ce principe ? Quelles sont les conditions à remplir ?

Étude de cas : La Khan Academy

La Khan Academy a adopté le principe « Atteindre des objectifs éducatifs », mais elle ne s’est pas arrêtée au simple intitulé. Elle a défini des critères qui précisent ce que signifie respecter ce principe :

« Il existe un objectif éducatif clair pouvant être atteint grâce à l’IA »

« Un plan de suivi et d’évaluation permet de mesurer l’impact »

« Des mécanismes sont en place pour prévenir les usages non éducatifs de l’IA »

Remarquez que ce ne sont pas encore des règles détaillées de mise en œuvre, mais des critères au niveau du principe. Ils définissent ce que le principe exige sans préciser exactement comment l’atteindre. Cette spécificité vient plus tard, lorsque vous élaborez des politiques (en savoir plus ici) et réalisez des évaluations des risques (en savoir plus ici).

L’intérêt de définir les principes à ce niveau : l’équipe peut désormais se poser les questions suivantes : « Notre fonctionnalité IA proposée a-t-elle un objectif éducatif clair ? » « Avons-nous un plan pour mesurer l’impact ? » « Quels mécanismes permettraient de prévenir les usages inappropriés ? » Le principe fournit les questions, tandis que les politiques et les travaux d’évaluation des risques fournissent les réponses.

Étude de cas : ChangemakerXchange

CXC a défini le principe « Utilisation réfléchie » avec des questions concrètes que son équipe se pose avant toute utilisation de l’IA :

« L'IA est-elle vraiment nécessaire pour cette tâche ? »

« "Est-ce vraiment conforme à nos valeurs ? »

« Qu'est-ce que je perds lorsque j'utilise cet outil pour cette tâche ? »

Ils ont également précisé à quoi cela ressemble dans la pratique : « Certaines tâches nécessitent toute notre attention et tous nos soins, comme rédiger un message sincère aux membres, élaborer une théorie du changement ou concevoir une séance pour l’une de nos sessions. Lorsque de telles choses sont trop déléguées à l'IA, elles risquent de perdre de leur profondeur, de leur authenticité ou de leur sens ».

Le principe devient applicable parce qu'il est défini en fonction de leur travail spécifique.

Résultat : → Utiliser la fiche Définir les principes d'une IA responsable dans la feuille Identifier | Définir les principes de l'IA pour obtenir ce résultat pour chaque principe.

Ces définitions deviennent le fondement de vos structures et politiques de gouvernance.

2.3 L'importance de la diversité des voix

Les personnes qui participent à ce processus sont aussi importantes que le processus lui-même.

Pourquoi la diversité est importante :

Les personnes les plus proches de votre mission voient les risques que la direction ne voit pas.

Le personnel en première ligne comprend comment l’IA affecte réellement le travail quotidien.

Les membres de la communauté peuvent signaler des impacts que les équipes internes risquent de négliger.

La diversité des perspectives permet d’éviter les angles morts et le conformisme de groupe.

Lorsque les gens participent à l'élaboration des principes, ils deviennent les garants de ces valeurs.

Qui doit être présent dans la salle :

La direction (pour l’adhésion et l’autorité nécessaire aux engagements)

Le personnel des programmes et opérations (pour prendre en compte la réalité pratique)

Le personnel technique, si vous en disposez (pour des informations sur la faisabilité)

Les équipes de communication ou des relations externes (pour la perspective des parties prenantes)

Le personnel administratif (souvent premiers utilisateurs d’outils IA pour gagner en efficacité)

Si possible : membres de la communauté, bénéficiaires ou partenaires

Le Manifeste de la CXC est le fruit d'une écoute approfondie de l'équipe. Le cadre de travail de la Khan Academy est géré par un groupe de travail transversal incluant les équipes produit, données et recherche utilisateur, ce qui garantit que des perspectives diverses façonnent son approche.

Conseils de facilitation :

Créez un climat de sécurité psychologique : pas de jugement, pas de « mauvaises » réponses

Privilégiez d’abord la réflexion individuelle avant la discussion de groupe (cela évite que les voix dominantes prennent le dessus)

Invitez explicitement les participants plus réservés à s’exprimer

Consignez les points de vue divergents, pas seulement le consensus

Envisagez des mécanismes de contribution anonymes pour les sujets sensibles

Rappelez que le désaccord est une source d’information, pas un échec

Évitez le « théâtre d'entreprise » :

L'objectif n'est pas de produire un document impeccable que la direction approuve. L'objectif est une véritable co-création : des principes auxquels votre équipe croit parce qu'elle a contribué à les façonner.

Si votre première séance fait émerger de véritables désaccords, c’est une force, pas un problème. Ces tensions sont une source d’information. Elle peuvent indiquer que vous avez besoin d'une discussion plus approfondie avant de vous engager sur un principe, ou qu'un principe doit être défini avec plus de soin pour tenir compte des différentes perspectives.

Le processus de création des principes est aussi important que les principes eux-mêmes.

Veillez à poursuivre avec la Partie 3 : Mise en pratique, pour savoir comment identifier les principes de l'IA qui comptent le plus pour votre OSC.

Votre avis compte!

Que pensez-vous de ce texte ? Prenez 30 secondes pour partager votre retour et nous aider à créer un contenu significatif pour la société civile!

Cet article est la deuxième partie d'une série intitulée « Feuille de route pour une IA responsable pour les OSC », élaborée dans le cadre de l’initiative L'IA au service du changement social du programme d'activisme numérique de TechSoup, avec le soutien de Google.org.

A propos de l'auteur

Ayşegül Güzel est une architecte en gouvernance de l'IA responsable qui aide les organisations axées sur une mission à transformer l'anxiété liée à l'IA en systèmes dignes de confiance. Sa carrière combine le leadership social exécutif — notamment en tant que fondatrice de Zumbara, le plus grand réseau mondial de banques de temps — et la pratique technique de l’IA, en tant qu’auditrice certifiée en IA et ancienne data scientist. Elle guide les organisations à travers des transformations complètes de la gouvernance de l'IA et réalise des audits techniques en IA. Elle enseigne à ELISAVA et intervient à l’international sur les approches centrées sur l’humain dans la technologie. Pour en savoir plus, consultez https://aysegulguzel.info ou abonnez-vous à sa lettre d'information AI of Your Choice à l'adresse https://aysegulguzel.substack.com.